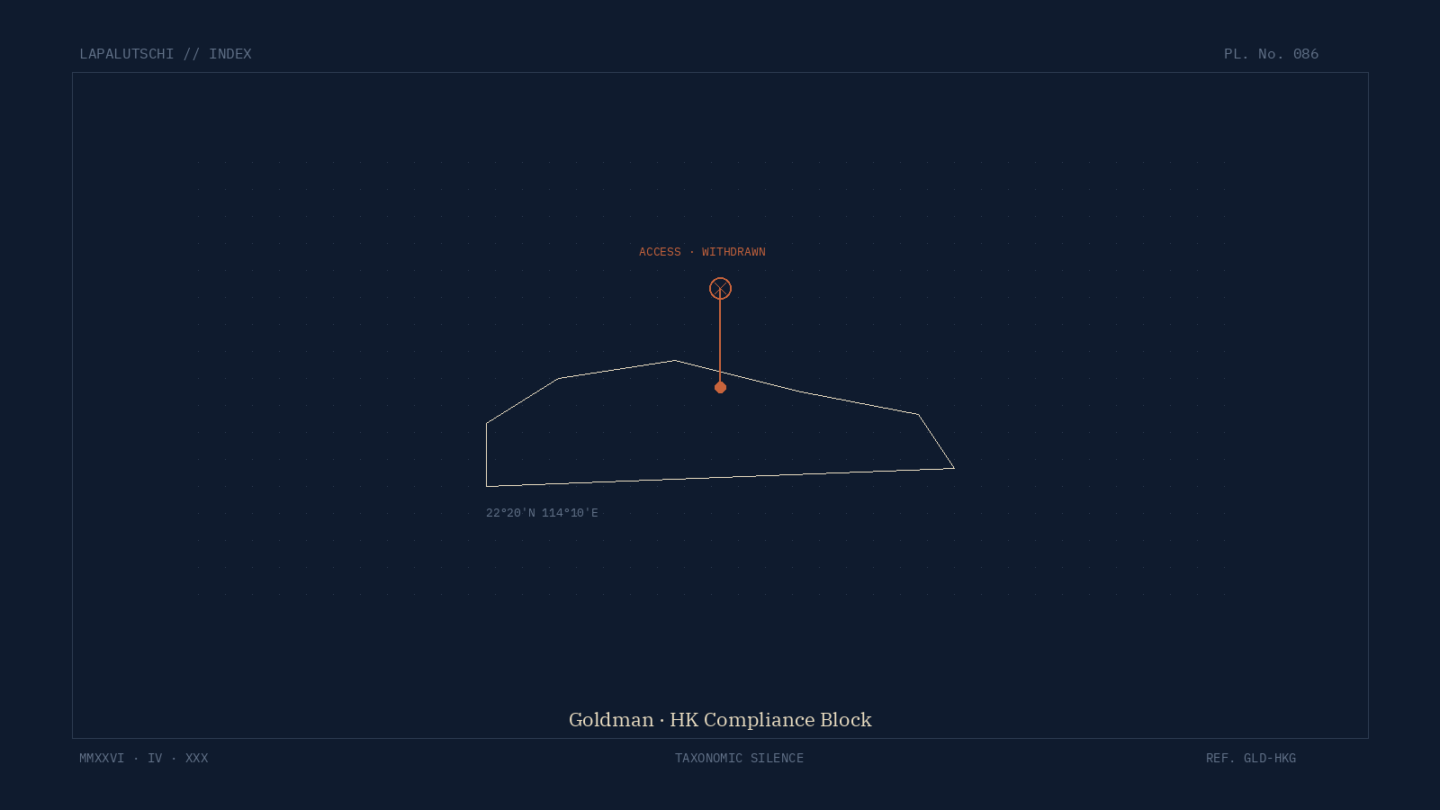

Stille im Goldman-Tower in Hongkong. Die rund 1500 Mitarbeitenden im dortigen Büro können Anthropics Claude seit dieser Woche nicht mehr für interne Aufgaben nutzen. Bloomberg hat die Sperre am 29. April öffentlich gemacht.

SCHOCK: US-Compliance trifft auf chinesische Verwaltung

Hintergrund sind die verschärften US-Exportregeln für KI-Software. Anthropic darf die Modelle Banken nur dann verkaufen, wenn die Verarbeitung außerhalb von Festlandchina, Macau und Hongkong stattfindet. Goldman wertet das als rote Linie und schaltet den Zugang lieber selbst ab, als sich juristisch verbiegen zu müssen.

Die Bank betont, dass es keine direkte Anweisung aus Washington gibt. Die Sperre sei eine vorsichtige Auslegung – nicht eine Reaktion auf einen konkreten Vorfall.

UNGLAUBLICH: Andere Standorte laufen weiter

New York, London, Frankfurt, Tokio, Singapur – alles offen. Nur Hongkong fällt raus. Damit hat Goldman eine klare Linie gezogen, die zugleich ein Signal an andere Banken setzt. Wer auf Anthropic-Tooling baut und gleichzeitig Greater-China-Geschäft fährt, muss seine eigene Compliance-Architektur prüfen.

Branchen-Insider rechnen damit, dass Morgan Stanley, JP Morgan und Citi in den kommenden Wochen ähnliche Schritte abwägen.

So bereitest du dich auf vergleichbare Sperren vor

- Datenfluss kartografieren. Wer welche KI-Tools wo nutzt, gehört in eine simple Matrix. Standort × Tool × Datentyp – das ist die Basis jeder Risikoabschätzung.

- Vertragsklauseln lesen. Schau im Anthropic-Enterprise-Vertrag nach den Geo-Restriktionen. Wer als europäisches Unternehmen Greater-China-Geschäft fährt, sollte den Passus mit dem eigenen Anwalt prüfen.

- Plan B definieren. Lokal verfügbare Modelle (Mistral, Aleph Alpha, lokale GPT-OSS-Modelle) als Fallback durchspielen. Nicht erst dann, wenn das Tool plötzlich weg ist.

EXTRA-TIPP: Bring-your-own-Cloud nicht überschätzen

Manche Teams hoffen, mit eigener Cloud-Anbindung am Verbot vorbeizukommen. Funktioniert nur teilweise: Anthropic prüft im Enterprise-Setup gezielt die geographische Zuordnung der API-Calls. Wer die Region falsch flaggt, landet im nächsten Audit auf einer roten Liste.

FAZIT: KI ist jetzt Geopolitik

Der Goldman-Vorfall zeigt, wie schnell KI-Tools zum politischen Werkzeug werden können. Wer KI breit ausrollt, baut sich Abhängigkeiten ein, die im falschen Moment kippen. Eine saubere Compliance-Architektur ist ab 2026 keine Kür mehr, sondern Pflicht.