Wer mit großen Sprachmodellen arbeitet, kennt das Problem: Prompt rein, Pause, Antwort fließt langsam. Cloudflare hat diese Wartezeit jetzt brutal verkürzt. Die Edge-Truppe hat ihre LLM-Infrastruktur in zwei Teile gesplittet — Prefill und Decode laufen auf eigenen GPU-Pools. Das Ergebnis: P90-Latenz pro Token fällt von 100 ms auf 20-30 ms. Drei Mal schneller. Wer KI-Agenten am Edge baut, sollte hellhörig werden.

SCHOCK: GPUs gehören jetzt zwei Welten

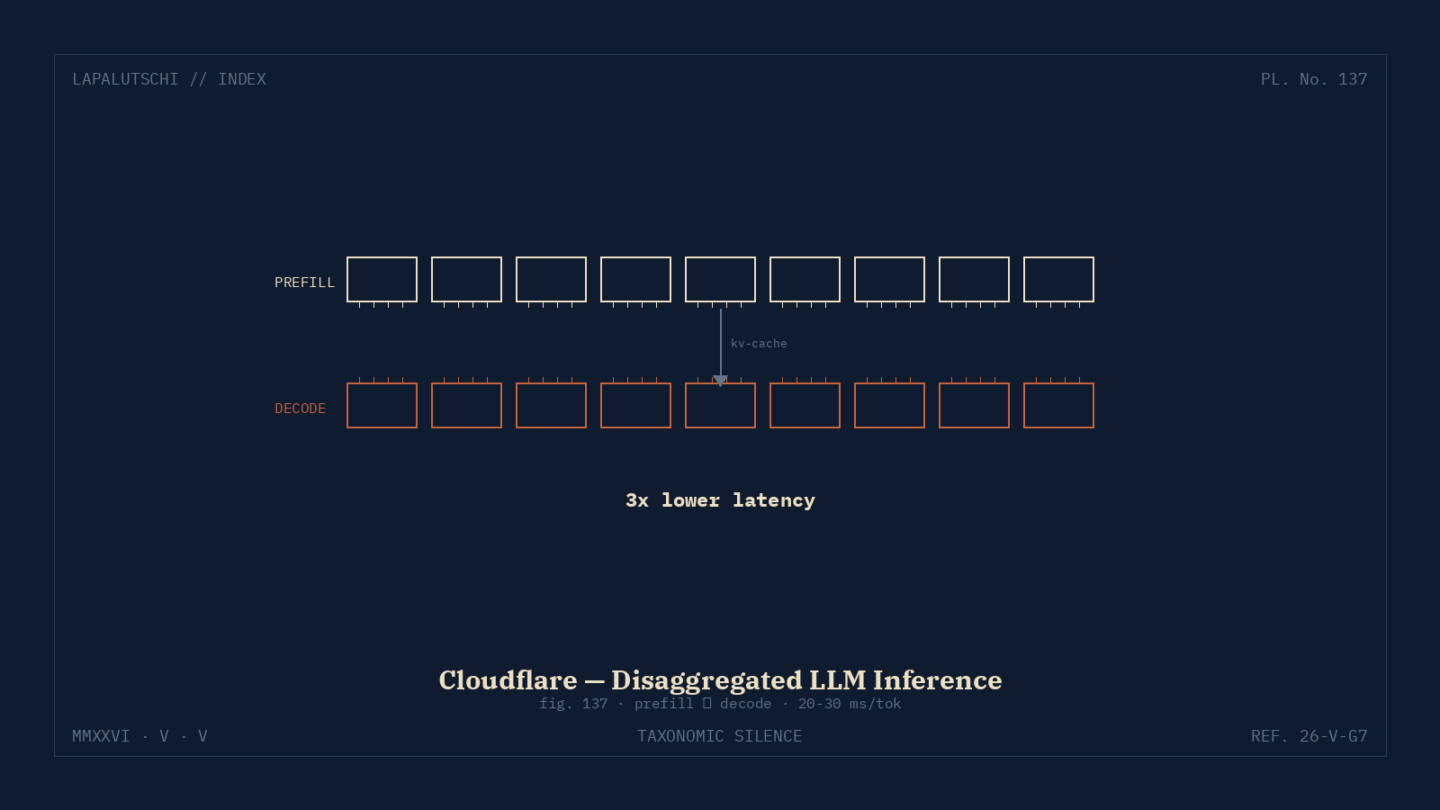

Wer schon mal versucht hat, ein 70-Milliarden-Parameter-Modell auf einer einzigen GPU zu jagen, kennt den Engpass: Die Karte muss erst den ganzen Prompt verarbeiten (Prefill, baut KV-Cache), dann Token für Token die Antwort generieren (Decode). Beides sind völlig unterschiedliche Profile. Prefill ist kompute-intensiv, Decode ist memory-bandbreiten-intensiv.

Auf einer einzigen Karte blockieren sich die Phasen gegenseitig. Genau das ändert Cloudflare jetzt: Eine Prefill-GPU-Gruppe macht nur die Eingabe-Verarbeitung. Sobald der KV-Cache steht, wandert er zur Decode-Gruppe, die dort nichts anderes tut, als Token für Token zu generieren. Maximal Auslastung pro Phase, maximale Geschwindigkeit pro Token.

UNGLAUBLICH: 3x niedrigere Latenz

Die Zahlen, die Cloudflare im InfoQ-Bericht und im eigenen Blog präsentiert, sind beeindruckend: P90 Time-per-Token fällt von rund 100 ms auf 20-30 ms. Heißt: Wenn du heute auf eine 100-Wort-Antwort 4 Sekunden gewartet hast, sind es bald rund 1,3 Sekunden. Diese Geschwindigkeit entscheidet darüber, ob ein KI-Agent „natürlich“ wirkt oder klobig.

Dazu kommt: Die Variance — also wie stark die Latenz schwankt — sinkt deutlich. Vorher war die Standard-Abweichung hoch, jetzt ist sie gleichmäßig. Für KI-Agenten, die auf Cloudflare-Workers AI laufen, heißt das vorhersagbare Antworten.

HAMMER: Eigene Inferenz-Engine + „Unweight“

Cloudflare hat parallel die eigene Inferenz-Engine released, die GPUs effizienter verwaltet als Standard-vLLM. Sie wird nicht offen released, läuft aber unter der Haube von Workers AI. Dazu kommt Unweight — eine selbst entwickelte Modell-Kompression, die Gewichte um 15-22 % schrumpft, ohne Genauigkeit zu verlieren.

EXTRA-TIPP: So nutzt du es heute

Wer Workers AI nutzt, profitiert automatisch — ohne Code-Änderung. Wer aber das Maximum will, sollte die Streaming-API nutzen, statt auf das ganze Antwort-JSON zu warten. Damit bekommen deine User Token so wie sie generiert werden. Bei der neuen Latenz fühlt sich das fast wie ein lokales Modell an.

SO ordnet sich Cloudflare ein

Hyperscaler wie OpenAI und Anthropic optimieren seit Monaten an genau dieser Architektur. Was an Cloudflare bemerkenswert ist: Sie haben technische Details öffentlich gemacht. Damit drückt der Edge-Anbieter den Markt — andere Cloud-Provider werden nachziehen müssen, sonst sehen sie schlecht aus.

FAZIT: Wer KI-Agenten auf Cloudflare laufen lässt, bekommt ohne Zutun einen brutalen Speed-Boost. Wer noch zögert, sollte den Edge-Stack jetzt evaluieren. Das ist nicht „inkrementell besser“ — das ist eine Architektur-Generation weiter.

Quellen

- InfoQ — Cloudflare High-Performance LLM Infrastructure

- Cloudflare Blog — Building the foundation for running extra-large LLMs

- Cloudflare Blog — Most efficient AI inference engine