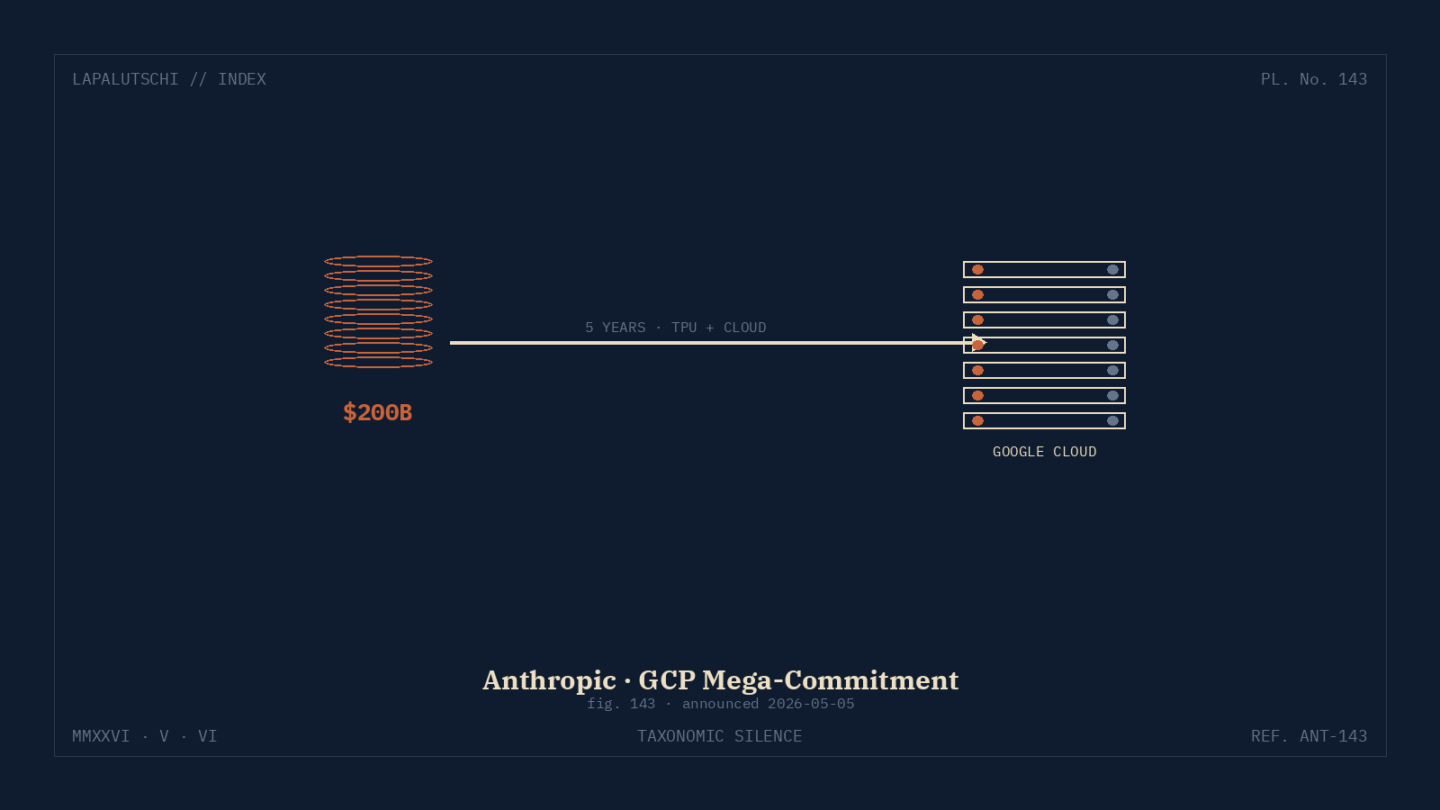

Mega-Headline aus dem Silicon Valley: Anthropic hat sich offenbar verpflichtet, in den nächsten fünf Jahren 200 Milliarden US-Dollar bei Google Cloud zu lassen. Das melden The Information und Reuters am 5. Mai 2026 unter Berufung auf Quellen mit Einblick in den Vertrag. Damit klettert Google in der KI-Cloud-Liga nochmal eine Stufe höher — und Anthropic sichert sich Compute-Kapazität für die nächste Claude-Generation.

UNGLAUBLICH: Cloud + TPU im Doppelpack

Der Deal soll laut den Berichten zwei Säulen umfassen. Säule eins: klassische Cloud-Compute, also Storage, Networking, Managed Services. Säule zwei: Custom-TPU-Bestellungen der kommenden TPU-Generationen, die Google für KI-Training und -Inference massschneidert. Zusammen ergibt das eine Abnahme-Garantie, mit der Google die Roadmap planen kann — und Anthropic eine Versorgungs-Garantie für die Claude-Familie.

Klingt gross? Ist es. 200 Milliarden über fünf Jahre sind im Schnitt 40 Milliarden pro Jahr — mehr als das jährliche Cloud-Geschäft mancher Mittelständler in DACH zusammengenommen.

SCHOCK für die Konkurrenz

AWS bleibt zwar an Bord — Amazon ist seit dem ersten Funding-Round Anthropic-Investor und stellt weiter Inferenz-Kapazität über Bedrock. Aber das Schwergewicht verschiebt sich klar nach Mountain View. Microsoft mit dem OpenAI-Päckchen muss kontern; AWS‘ eigenes Trainium-Programm steht plötzlich unter Lieferdruck. Wer in den nächsten Monaten KI-Workloads platziert, sollte den Cloud-Mix doppelt kalkulieren.

HAMMER: Was du als Claude-Nutzer SOFORT spürst

- Mehr TPU-Pods online: die ersten Custom-TPU-Cluster laufen laut Bericht bereits in den Anthropic-Workflow ein.

- Weniger Capacity-Errors: die berüchtigten 529-Throttles in Spitzenzeiten sollten deutlich seltener werden.

- Latenz runter: mit eigenen TPU-Slots fallen die Cold-Starts und gepoolten Wartezeiten weg.

- Preis-Druck: bei steigendem Hardware-Volumen ist Spielraum für günstigere API-Preise — schon Opus 4.7 hatte den Preis stabil gehalten.

EXTRA-TIPP: Eigene Workloads anpassen

Wer seinen Stack auf AWS-Bedrock-Claude gebaut hat, sollte den parallelen Anthropic-Direkt-Endpoint im Auge behalten — der läuft längst auf Google Cloud und profitiert direkt vom neuen Compute. Bei eigenem Homelab-Setup mit Ollama oder vLLM ändert sich nichts; aber bei hybridem Cloud-Routing kann es sich lohnen, den Traffic zwischen den Providern intelligent zu verteilen. Dazu eine kleine Routing-Lambda mit Latenz-Sensor — fertig.

SO ordnet sich das in den Anthropic-News-Tag ein

Der 200-Milliarden-Deal ist nicht das einzige Anthropic-Highlight am 5. Mai. Parallel hat das Unternehmen zehn Finanz-Agent-Templates rausgehauen und die Claude-Add-ins für Microsoft 365 allgemein freigeschaltet. Anders gesagt: Anthropic baut die Cloud-Infrastruktur (Google), die Tools (Microsoft 365) und den Vertrieb (Goldman, Blackstone) parallel aus. Das ist klassischer Plattform-Move.

FAZIT: Plan deinen KI-Stack längerfristig

Wenn du Claude in der Produktion einsetzt, kannst du jetzt mit deutlich stabileren Kapazitäten rechnen — und solltest beim nächsten Vertragsverlängerungs-Termin auch über höhere Rate-Limits verhandeln. Investoren-seitig zeigt der Deal: die Skalierung ist gesichert, der Rest ist Execution. Behalte die Q3-Zahlen im Auge, und richte dein Monitoring auf den Anthropic-Direct-Endpoint aus — da läuft die Musik.