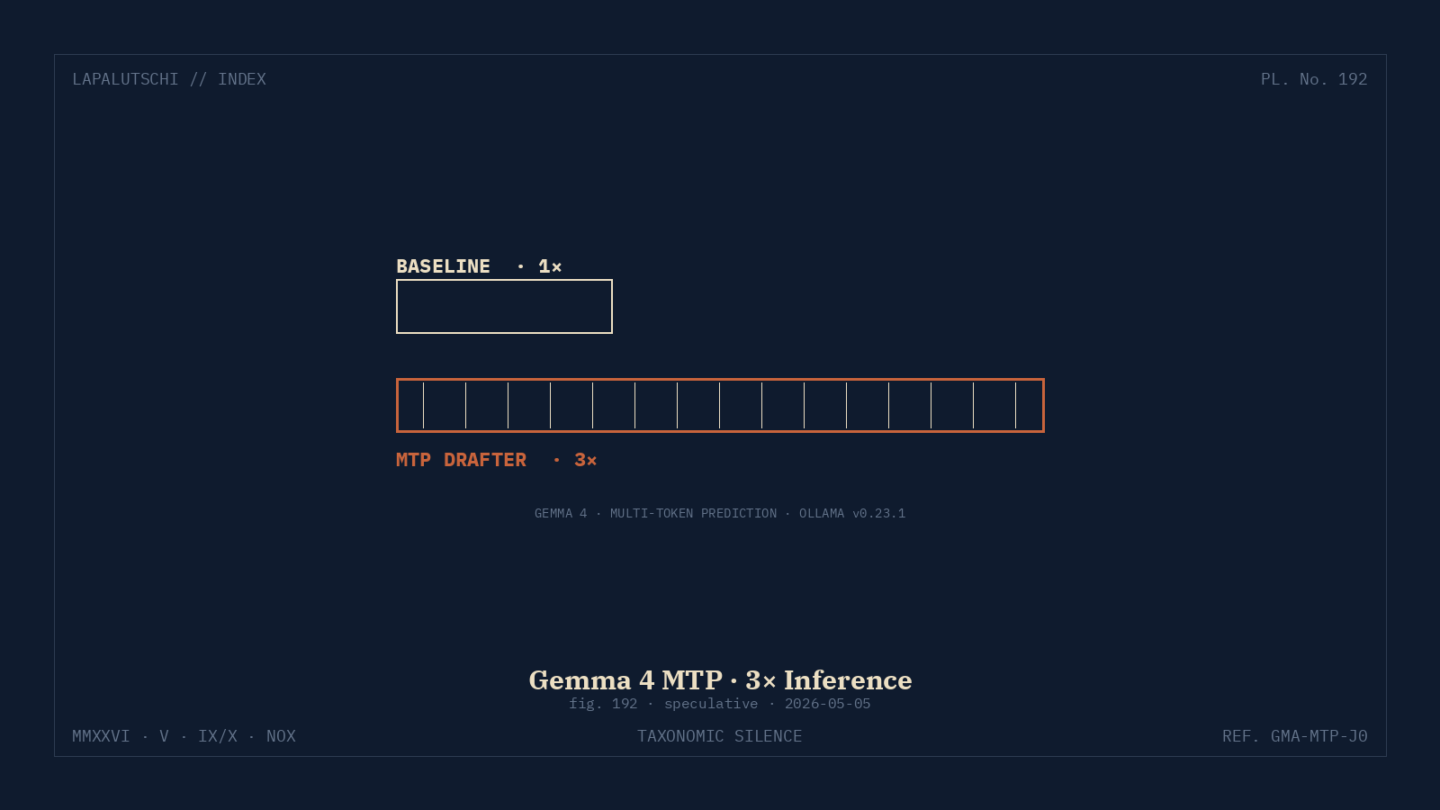

Wenn du Gemma 4 lokal laufen lässt – auf Mac, Linux oder im Homelab – wird dein Wochenende schöner: Google hat Multi-Token-Prediction-Drafter für Gemma 4 freigegeben. Das macht deine Inferenz bis zu 3-mal schneller, ohne dass die Antwort schlechter wird.

HAMMER: Speculative Decoding mit echtem Speed-Up

Hinter MTP steckt ein bekanntes Trick-Verfahren: ein winziges Draft-Modell schlägt mehrere Tokens auf einmal vor, das große Modell verifiziert sie. Wenn die Drafts gut sind, kommen 2 bis 3 Tokens pro Forward-Pass durch – im Schnitt 3-fache Tokens pro Sekunde.

SO sieht’s auf Apple-Silicon aus

Google hat MTP nicht nur für Cloud-GPUs, sondern auch für Apple Silicon getunt. Auf einem MacBook Pro M4 Max mit 64 GB landet Gemma 4 31B im Coding-Benchmark bei rund doppelt so vielen Tokens pro Sekunde wie ohne MTP. Ist nicht ganz die 3x-Marketing-Zahl, aber für lokale Coding-Sessions Gold wert.

SCHOCK: Ollama 0.23.1 macht den Knopf scharf

Der einfache Weg, das auf deinem Rechner zu testen:

- Ollama auf 0.23.1 updaten (oder neuer).

ollama pull gemma4:31b-mtp– das Drafter-Modell wird automatisch mitgezogen.ollama run gemma4:31b-mtp– fertig.

Beim ersten Prompt siehst du den Speed-Up sofort. Code-Antworten, Übersetzungen und strukturierte Tabellen profitieren am meisten.

EXTRA-TIPP: Claude Desktop kann jetzt Ollama

Mit Ollama 0.23.1 kommt nebenbei eine neue Bridge: Claude Desktop kann Ollama-Modelle direkt anbinden. Heißt: du chattest mit Claude, ziehst aber Gemma 4 für lokale Coding-Tasks ran – ohne Cloud-Round-Trip. Praktisch, wenn du mit sensiblem Code arbeitest.

WO der Speed-Up zusammenbricht

Bei kreativen Aufgaben – Witze, Lyrik, Brainstorm-Listen – sinkt die Drafter-Trefferquote. Dann ist der Speed-Up nur noch 1,5x statt 3x. Bei strukturierten Tasks bleibt der Vorteil voll erhalten. Wer also Self-Host-LLM für IDE-Autocomplete betreibt, gewinnt deutlich; wer nur ChatGPT-Style-Plaudereien sucht, weniger.

FAZIT: Pflicht-Update für Self-Hoster

Mit dem Gemma-4-MTP-Drafter bekommst du echte Geschwindigkeit ohne Qualitätsverlust – kostenlos, im offiziellen Modell, auf jeder Plattform. Ollama updaten, neue Modell-Variante ziehen, fertig. Genau die Art von Update, die KI-Self-Hosting 2026 so attraktiv macht.

Häufige Fragen

Was ist Multi-Token-Prediction (MTP) eigentlich?

Funktioniert das auch auf Apple-Silicon?

Welche Ollama-Version brauche ich?

Wo bricht der Speed-Up zusammen?

Quellen: BuildFastWithAI Gemma-4-MTP-Guide, Ollama Release-Notes 0.23.1.