Wer als Entwickler auf Vercel deployt, hat oft Context AI als Helper integriert – ein Coding-Assistant für Pull-Request-Kontext. Genau diese Hilfsbeziehung ist zur Falle geworden. Am 19. April 2026 hat Vercel einen Security-Incident bestätigt, ausgelöst durch einen Komplettangriff auf Context AI.

HAMMER: Lumma-Stealer fing den ersten Domino

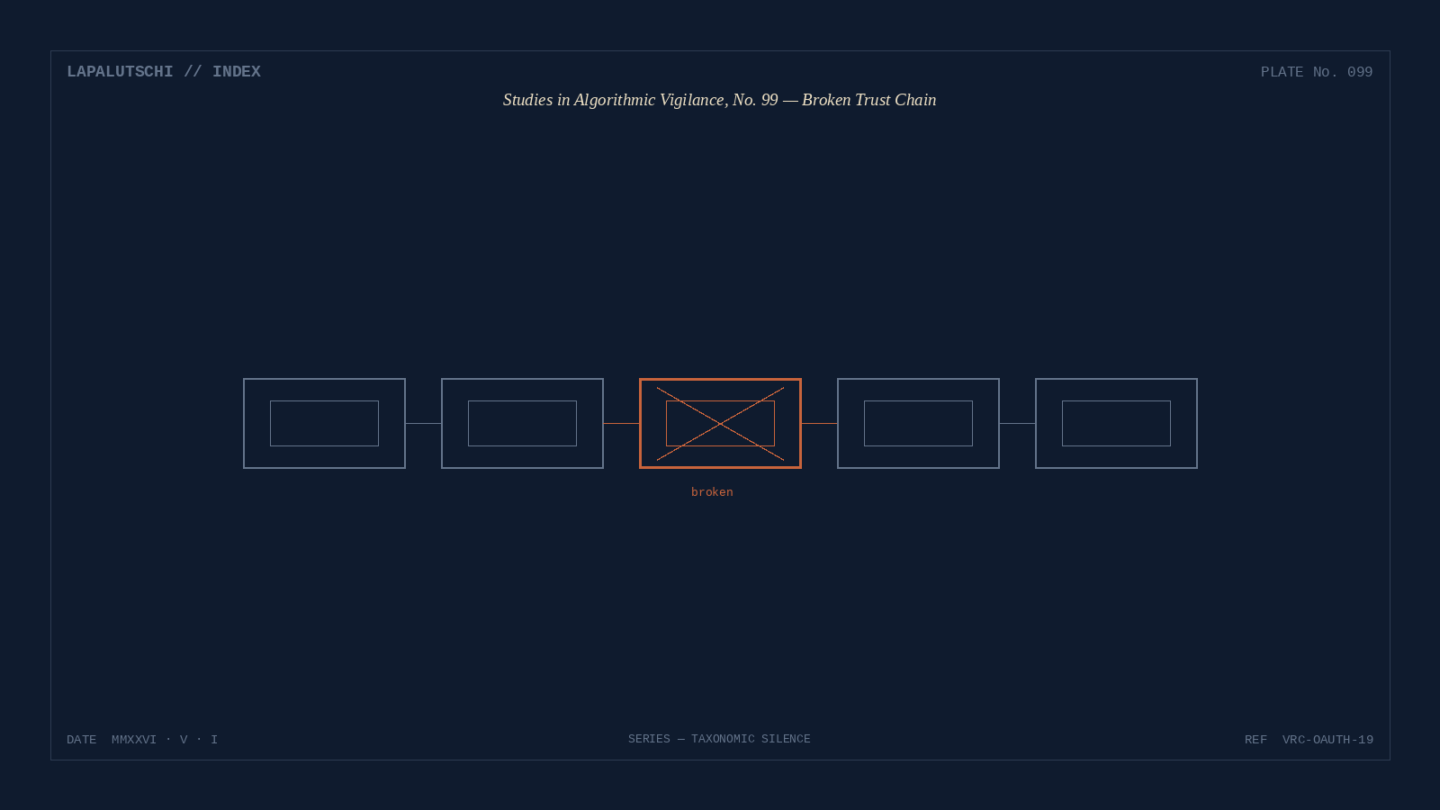

Der Angriff begann im Februar 2026 mit einer Lumma-Stealer-Infektion bei Context AI. Lumma ist ein klassischer Infostealer, der Zugangsdaten und OAuth-Tokens aus Browsersitzungen einsaugt. Die Beute: Google-Workspace-OAuth-Tokens von Context-Mitarbeitern, dazu Keys für Supabase, Datadog, Authkit – und der berüchtigte Account support@context.ai.

Mit diesen Tokens kletterte der Angreifer in das Google-Workspace eines Vercel-Mitarbeiters, der Context AI im Alltag nutzte. Von dort aus wurde sein Vercel-Konto übernommen – und der Tunnel ins Vercel-Backend war offen.

SCHOCK: Nicht-sensible Env-Vars wurden ENTSCHLÜSSELT

Sobald der Angreifer im Vercel-Workspace war, hat er Umgebungsvariablen aufgezählt und entschlüsselt – allerdings nur die, die Vercel als „nicht sensibel“ klassifiziert hatte. Der Witz dabei: für „nicht sensibel“ ist at-rest-Encryption nicht erzwungen. Für einen internen Angreifer waren die Variablen damit klartextlesbar.

Wichtig zu wissen: npm-Pakete von Vercel sind sauber. Vercel, GitHub, Microsoft, npm und Socket haben gemeinsam bestätigt, dass kein Lieferketten-Paket manipuliert wurde. Dein next, dein @vercel/og, alles unverdächtig.

UNGLAUBLICH: Datenbank steht für 2 MIO. DOLLAR im Forum

Auf BreachForums wurde nach dem Vorfall ein angeblicher Vercel-DB-Auszug für 2 Millionen US-Dollar ausgeschrieben. Vercel selbst hat die Reichweite kleingeredet, aber das Auftauchen reicht aus, um nervös zu werden – wer auf Vercel hostet, sollte alle exponierten Variablen rotieren.

SO checkst du JETZT, ob du betroffen bist

- Im Vercel-Dashboard alle Environment Variables auflisten und in „sensitive“ und „nicht sensitive“ trennen.

- Alle nicht-sensiblen Variablen rotieren – inklusive API-Keys für Drittanbieter, die dort liegen.

- Audit-Logs der letzten 60 Tage auf untypische Lese-Operationen prüfen, vor allem unbekannte IPs.

- Dritte OAuth-Apps in Google Workspace und im Vercel-Account auf minimalen Scope reduzieren.

EXTRA-TIPP: Lass deine Tokens mit Github-Secret-Scanning gegenchecken

Wenn du Vercel-Env-Vars auch in GitHub Secrets hast, dreh GitHub Secret Scanning auf maximaler Stufe. Im Zweifelsfall alle Tokens mit jüngerem Erstellungsdatum als Februar 2026 als kompromittiert behandeln und neu generieren.

FAZIT: Supply-Chain-Sicherheit ist KEINE Vendor-Eigenheit mehr

Der Vercel/Context-Vorfall ist ein Schulbuch-Beispiel für AI-Supply-Chain-Risiken. Ein einziges KI-Helferlein reicht, damit ein Lumma-Sample auf einem fremden Laptop deine Production-Variablen ans Tageslicht zerrt. Die Lehre: jede OAuth-App, die du mit deinem Workspace verbindest, ist eine potenzielle Hintertür. Audit deinen App-Garten heute.