Endlich raus aus der Beta: Volume Group Snapshots sind in Kubernetes 1.36 General Available. Damit kannst du mehrere Persistent Volume Claims gleichzeitig snapshotten — und zwar konsistent. Wer Datenbanken oder Message-Queues mit getrennten Disks fuer Daten und Logs betreibt, freut sich JETZT.

UNGLAUBLICH: Konsistente Snapshots ueber mehrere PVCs

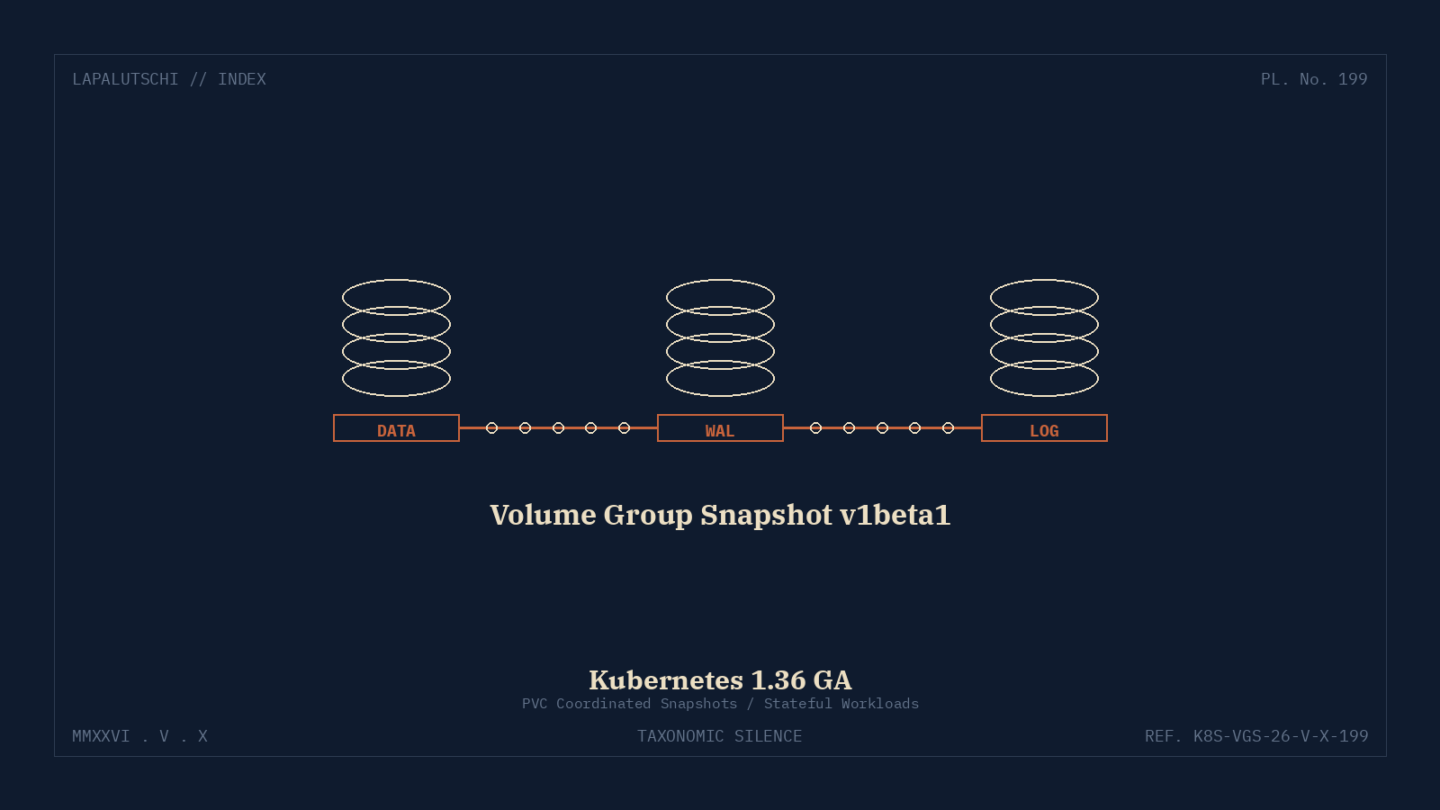

Klassische Volume-Snapshots schiessen ein Foto pro PVC — unabhaengig voneinander. Bei einer Postgres-Instanz mit getrenntem PVC fuer Tablespaces und WAL-Log konnten dabei Inkonsistenzen entstehen. Lock-Reihenfolge falsch, Latenz zwischen den Snapshots, schon ist das Backup nutzlos.

Volume Group Snapshots loesen das Problem: ein API-Call, mehrere PVCs, alle gleichzeitig eingefroren. Voraussetzung ist ein CSI-Treiber, der das Feature unterstuetzt — Cinder, Ceph RBD, Portworx und einige Cloud-Provider sind bereits dabei.

NEU: Declarative Validation auch GA

Im selben Release knallt Kubernetes auch die Declarative Validation fuer native Typen auf GA. Was bisher Code-Generator-Magie in kube-openapi war, ist jetzt deklarativ in den API-Definitionen — Validierung, die im API-Server konsistent laeuft, ohne Round-Trip durch Plugins.

Fuer dich heisst das: schnellere API-Antworten, klarere Fehlermeldungen bei kaputten YAMLs und die Vorbereitung fuer die naechste Welle an Custom Resource Definitions.

Welche CSI-Treiber JETZT mitziehen

- Ceph CSI: Volume Group Snapshots ab 3.10, RBD und CephFS.

- Cinder CSI (OpenStack): ab 1.36 Release, OpenStack Antelope+.

- Portworx: seit 3.0 produktiv, jetzt mit Vendor-spezifischer Group-Policy.

- AWS EBS CSI: Beta, GA in 1.37 erwartet.

- Azure Disk CSI: Alpha, Roadmap-Termin Q3 2026.

- GCE Persistent Disk: Beta-Status.

Die Open-Source-Storage-Community bewegt sich schneller als die Hyperscaler. Wer eigene Cluster betreibt, profitiert frueher.

So nutzt du Volume Group Snapshots in der Praxis

Erstelle erst eine VolumeGroupSnapshotClass, die deinen CSI-Treiber referenziert. Dann eine VolumeGroupSnapshot-Resource mit persistentVolumeClaimSelector:

apiVersion: groupsnapshot.storage.k8s.io/v1beta1

kind: VolumeGroupSnapshot

metadata:

name: postgres-snap-2026-05-10

spec:

source:

selector:

matchLabels:

app: postgres

volumeGroupSnapshotClassName: ceph-rbd-group

Alle PVCs mit Label app=postgres werden in einem Rutsch gesnapshottet. Die Restore-Logik laeuft analog — eine VolumeGroupSnapshot-Restore-Resource bringt mehrere PVCs zurueck.

EXTRA-TIPP: Velero-User koennen die VGS-API ab Plugin-Version 1.17 direkt einbinden. Damit hast du clusterweite Backup-Plaene, die Group-Snapshots automatisch nutzen.

FAZIT: Stateful Workloads sind erwachsen geworden

Stateful Apps in Kubernetes hatten lange einen schweren Stand. Mit Group Snapshots faellt eine der letzten Operations-Huerden. Kombiniere das mit Storage-Operatoren wie Postgres-Operator, MongoDB-Community oder Strimzi (Kafka), und du hast einen produktionsreifen Stack — auch fuer Datenbanken mit harten Konsistenz-Anforderungen.

Haeufige Fragen

Was ist neu in Kubernetes 1.36?

Lohnt sich das Update sofort oder kann ich warten?

Bricht das Update bestehende Konfigurationen?

Wie fuehre ich das Update durch?

Quellen: Kubernetes Blog: Release 1.36, Kubernetes GitHub Releases, Kubernetes Releases-Seite.